CotoELとChatGPTの比較検証

石田さんと丸山さん中心に、CotoELのデモ紹介を続けています。

その中でChatGPTでもペルソナが作れるけど、ChatGPTとCotoELではどの程度信頼性が違うのか、上司を説得するために検証した資料が欲しい、、というリクエストをいただきました。

そのため石田さんが検証調査を行ってくれました。

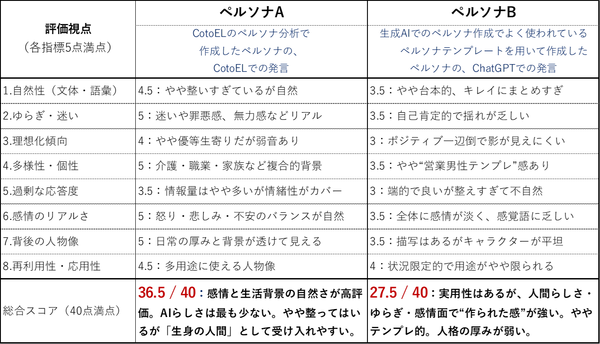

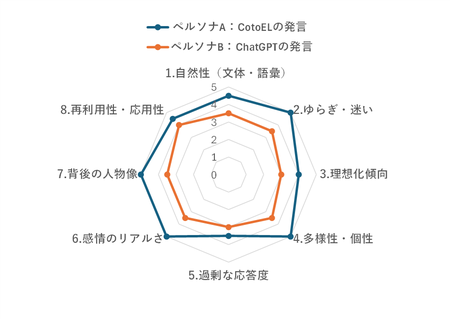

その結果、ChatGPTのペルソナより、実際にモニター個人が発言した数十件~数百件のアンケートデータをもとに構築した実在する個人のペルソナの方が信頼性が高いという結果が得られました。

生成AIでの評価で、ChatGPTが69点に対して、CotoELは91点という結果です。

詳細は下記のURLから検証レポートを見て下さい。

〇ペルソナ分析の発言比較

~ CotoEL とChatGPT の比較検証~

検証レポート https://www.myvoice.co.jp/voice/kobetu/Persona_TalkComp250814.pdf

=====(石田さんのレポートより抜粋)=====

生成AIの発言に対する2つの疑問と、比較検証を行った背景

近年、生成AIの活用が進む中で、発言の“人間らしさ”については以下のような疑問がよく聞かれます。

① AIはどれくらい“人間のように”思考や感情を語れるか(=模倣性)

→例えば「迷い」「葛藤」「弱音」といった発言に、リアリティがあるかどうか

② 生成された言語に“AIらしい不自然さ”が残っていないか(=自然性)

→「整いすぎた語尾」「説明的すぎる話し方」「感情が乏しい」など

CotoELは、実在のモニターが持つ18項目の属性情報(年齢・職業・家族構成など)

と、複数のアンケート回答をもとにn=1ペルソナを生成します。そのため、背景情報が豊富で、「まるで実在する人物と対話しているかのような」自然な発言が得られるのが特長です。

とはいえ、CotoELのデモの場では「本当に人間っぽいのか?」「無料の生成AIでもペルソナ分析は可能だが、そこと比較してどれくらい違うのか?」という声をいただくことがありました。

そこで今回、ChatGPTで作成したペルソナとCotoELのペルソナ発言を同一テーマ・同一質問で比較し、その違いを可視化する検証を行いました。

======

コメント